L'IA et la vie privée

Introduction

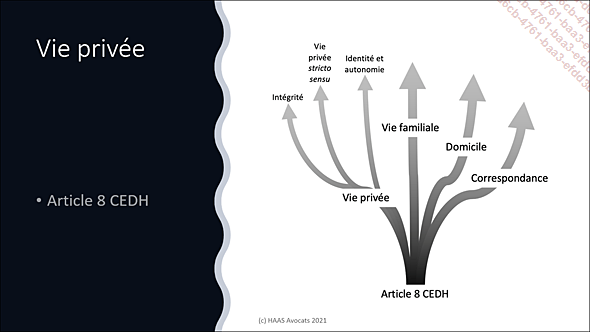

La définition la plus exhaustive de la vie privée en droit positif est vraisemblablement celle donnée par la jurisprudence de la Cour Européenne des droits de l’Homme à l’aune de l’article 8 de la Convention éponyme aux termes duquel : « Toute personne a droit au respect de sa vie privée et familiale, de son domicile et de sa correspondance. ».

Si pour l’essentiel cet article tend par la négative à prémunir l’individu contre les ingérences d’une autorité publique dans ses droits, il existe également un versant positif tendant pour la Cour à demander aux États membres qu’ils garantissent le respect de ce droit entre les parties privées1.

La Cour a défini le champ d’application de cet article de manière protéiforme en y décelant quatre branches : le droit au respect de la vie privée, le droit au respect de la vie familiale, le droit au respect du domicile, le droit au respect de la correspondance.

Puis, spécifiquement, la Cour a dégagé trois ramifications au sein de la vie privée : le droit à l’intégrité (physique, psychologique et morale, de la question de la fin de vie à celle de la vie sexuelle, etc.), le droit à la vie privée stricto sensu (droit à...

L’enjeu spécifique de la protection des données personnelles

Le législateur français a très tôt pris conscience de la nécessité d’encadrer le fichage des personnes physiques2 en promulguant il y a plus de quarante ans la loi informatique et libertés3. Lançant une inspiration européenne quant à la réglementation des « informations nominatives », l’Union Européenne a rapidement retourné le boomerang en définissant puis réglementant la protection des « données personnelles » par une directive de 19954 remplacée par le Règlement général pour la protection des données (RGPD) entré en vigueur le 25 mai 20185. En 2019, le législateur français a adapté la loi de 1978 pour laisser la part belle au Règlement en ce qui concerne les traitements de données personnelles à l’égard des personnes physiques.

L’étude des interactions entre l’intelligence artificielle et la protection des données personnelles se fera donc à la lumière des notions clés du RGPD, relativement adaptées et des droits et principes qu’il consacre, plutôt résilients.

1. L’adaptation des notions clés du RGPD aux nouveautés de l’IA

L’une des nouveautés majeures de l’IA est la capacité surhumaine de la machine à traiter l’immense quantité de données générées par l’interconnexion informatique des personnes. Par la data visualisation, l’IA permet d’exploiter et de représenter des données dont la quantité est inabordable par l’être humain.

Les statisticiens estiment que le volume annuel de données numériques créées à l’échelle mondiale pourrait être multiplié par 5 entre 2020 et 2025 et par 12 entre 2025 et 2035 faisant passer le volume de 47 milliards de téraoctets en 2020 à 2 142 milliards de téraoctets en 20356.

Mais le Big Data n’est pas qu’une question de volume, il repose également sur un enjeu de variété et de vitesse. Les sources de la donnée...

L’autonomie individuelle à l’épreuve de l’IA

Deux types de profilage font courir des risques à l’autonomie individuelle : il s’agit tout d’abord du profilage publicitaire réalisé par les Big Tech et du profilage sécuritaire réalisé pour le compte des autorités.

1. L’analyse prédictive à des fins commerciales

Rappelons que l’article 22 qui interdit le profilage prévoit en son point 2. c) que le profilage est autorisé du fait d’un consentement explicite de la personne concernée.

C’est précisément cette exception que font jouer les GAFAM dans leurs conditions générales d’utilisation.

Collecteurs de mégadonnées par excellence, du simple like au trajet de la souris en passant par les nombreuses données d’identité renseignées par l’utilisateur, les opérateurs de réseaux sociaux mettent en œuvre des traitements d’une précision bien supérieure à celle de l’être humain dans l’analyse de leur personnalité et la prédiction de leur comportement.

Ces traitements posent de réelles problématiques au regard du RGPD. Dans ces conditions, les articles 9 et 22 du RGPD prévoient le recueil d’un consentement renforcé, éclairé et informé. Or, dans la situation dominante qu’occupent les GAFAM, ce consentement est plus souvent le produit d’un contrat d’adhésion mal lu qu’un consentement explicite.

Par ailleurs, l’utilisateur qui ne consentirait pas au traitement de ses données ne serait pour autant pas assuré d’être à l’abri d’un profilage indirect via les data shadows, les données recueillies quant à sa personne auprès des autres utilisateurs ayant, eux, consenti.

Ce profilage fin et minutieux des utilisateurs permet...

Notes

1 Conseil de l’Europe, Cour Européenne des droits de l’Homme, Guide sur l’article 8 de la Convention Européenne des droits de l’homme, mis à jour au 31 août 2020.

2 F. Donnat, Revue Pouvoirs, L’intelligence artificielle, un danger pour la vie privée ?, 2019/3 n° 170, p. 95 à 103

3 Loi n° 78-17 du 6 janvier 1978 relative à l’informatique, aux fichiers et aux libertés

4 Directive abrogée 95/46/CE du Parlement Européen et du Conseil, du 24 octobre 1995, relative à la protection des personnes physiques à l’égard du traitement des données à caractère personnel et à la libre circulation de ces données.

5 Règlement (UE) 2016/679 du Parlement Européen et du Conseil du 27 avril 2016 relatif à la protection des personnes physiques à l’égard du traitement des données à caractère personnel et à la libre circulation de ces données abrogeant la Directive 95/46/CE du Parlement Européen et du Conseil, du 24 octobre 1995, relative à la protection des personnes physiques à l’égard du traitement des données à caractère personnel et à la libre circulation de ces données.

6 Statista Digital Economy Compass 2019...

Editions ENI Livres | Vidéos | e-Formations

Editions ENI Livres | Vidéos | e-Formations